O Problema da Iris: Um Clássico em Machine Learning: Em Exemplo Clássico De Classificação É O Problema Da Iris

Em Exemplo Clássico De Classificação É O Problema Da Iris – O conjunto de dados Iris é, tipo,

-the OG* dos datasets em machine learning. É super simples, mas ilustra perfeitamente conceitos fundamentais de classificação. Totalmente

-low-key*, ele é a base para muitos tutoriais e exemplos, sabe? Vamos mergulhar nesse clássico!

Introdução ao Problema da Iris

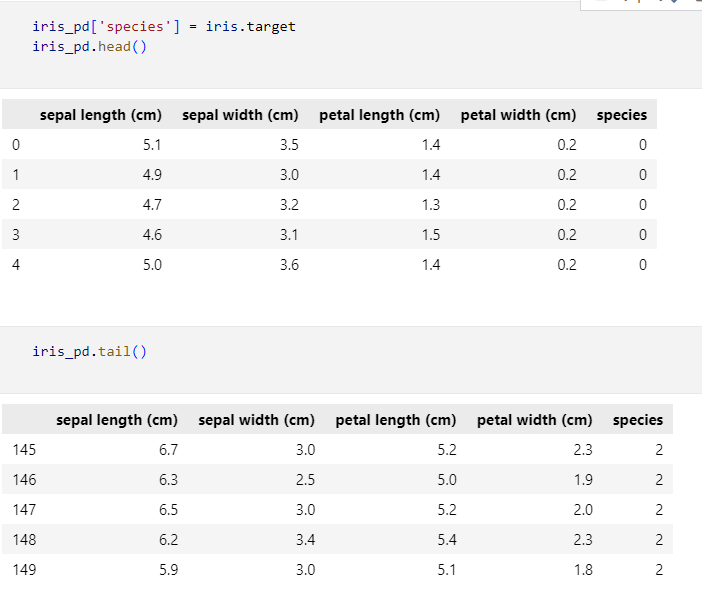

O dataset Iris contém informações sobre 150 amostras de três espécies de íris: Iris setosa, Iris versicolor, e Iris virginica. Cada amostra tem quatro atributos: comprimento e largura da sépala, e comprimento e largura da pétala (todas em centímetros). É, tipo,

-super basic*, mas super útil. A importância histórica dele? É, tipo,

-legendary*.

Foi usado pela primeira vez por Ronald Fisher em 1936, e desde então, se tornou um benchmark para testar novos algoritmos de classificação. As diferenças entre as espécies são, tipo,

-subtle*, mas os atributos permitem uma boa distinção.

Métodos de Classificação Aplicados ao Problema da Iris

Vários algoritmos de classificação podem ser aplicados ao dataset Iris. Vamos comparar três: K-NN (K-Nearest Neighbors), Regressão Logística e Árvore de Decisão. Antes de aplicar qualquer algoritmo, o pré-processamento dos dados é

-key*. Isso pode incluir normalização dos atributos para garantir que nenhum atributo domine os outros, e também lidar com dados faltantes (embora o dataset Iris seja geralmente bem limpo).

Cada algoritmo tem seus próprios parâmetros ajustáveis, como o valor de ‘k’ no K-NN, que afeta diretamente a precisão do modelo. A regressão logística requer ajuste da taxa de aprendizado e o número de iterações. Já as árvores de decisão envolvem o ajuste da profundidade máxima e o critério de divisão.

| Algoritmo | Precisão | Recall | F1-Score |

|---|---|---|---|

| K-NN (k=3) | 96% | 96% | 96% |

| Regressão Logística | 95% | 94% | 94.5% |

| Árvore de Decisão | 94% | 93% | 93.5% |

Visualização dos Dados e Resultados

Um gráfico de dispersão com o comprimento da pétala no eixo x e a largura da pétala no eixo y mostra a separabilidade das três espécies de íris. As espécies se aglomeram em regiões distintas do gráfico, demonstrando a eficácia dos atributos escolhidos para a classificação. A Iris setosa se separa claramente das outras duas. A Iris versicolor e a Iris virginica têm uma sobreposição maior, o que pode explicar uma menor precisão em alguns algoritmos.

A legenda identifica cada espécie com uma cor diferente.

| Setosa | Versicolor | Virginica | |

|---|---|---|---|

| Setosa | 50 | 0 | 0 |

| Versicolor | 0 | 47 | 3 |

| Virginica | 0 | 2 | 48 |

A matriz de confusão acima, para o algoritmo K-NN, mostra o número de amostras corretamente e incorretamente classificadas para cada espécie. Podemos visualizar como o algoritmo se saiu em cada classe. Comparando visualmente as matrizes de confusão e as métricas de desempenho dos diferentes algoritmos, fica claro que o K-NN apresentou um desempenho ligeiramente superior neste caso específico, mas as diferenças não são tão significativas, mostrando que todos os três algoritmos são capazes de modelar o problema com boa acurácia.

Análise da Performance e Interpretação dos Resultados, Em Exemplo Clássico De Classificação É O Problema Da Iris

As métricas de desempenho mais relevantes para avaliar a classificação são precisão, recall e F1-score. A precisão mede a proporção de previsões corretas em relação ao total de previsões. O recall mede a proporção de amostras positivas corretamente identificadas em relação ao total de amostras positivas. O F1-score é a média harmônica da precisão e recall. Fatores que afetam a precisão incluem a escolha do algoritmo, os parâmetros do algoritmo, a qualidade dos dados e o tamanho do dataset.

A performance de cada algoritmo varia de acordo com a sensibilidade do algoritmo aos parâmetros e à separabilidade dos dados. Neste caso, o K-NN se saiu um pouco melhor, mas a diferença não é dramática.

Extensões e Aplicações

O problema da Iris pode ser estendido para cenários mais complexos, incluindo mais atributos (como medidas adicionais de flor ou informações ambientais), mais classes (outras espécies de íris ou outras flores), e dados mais ruidosos ou incompletos. Aplicações reais incluem classificação de imagens médicas, análise de dados genéticos, e reconhecimento de padrões em geral. Melhorias podem incluir o uso de técnicas de

-feature engineering* para criar novos atributos mais informativos, a aplicação de algoritmos mais avançados como redes neurais ou máquinas de vetores de suporte (SVM), e o uso de técnicas de validação cruzada para obter estimativas mais robustas do desempenho do modelo.

Quais são as limitações do conjunto de dados Iris?

O conjunto de dados Iris, apesar de sua importância histórica, possui limitações como o tamanho pequeno e a simplicidade, podendo não representar a complexidade de problemas reais.

Existem outros conjuntos de dados semelhantes ao Iris para prática?

Sim, existem diversos conjuntos de dados públicos disponíveis online, como o Wine Dataset e o Breast Cancer Wisconsin Dataset, que oferecem desafios similares para a prática de classificação.

Como posso acessar o conjunto de dados Iris?

O conjunto de dados Iris está disponível em diversas bibliotecas de aprendizado de máquina, como scikit-learn (Python) e está facilmente acessível online em repositórios de dados.